英特尔推出滑块过滤“仇恨演讲”进行在线游戏

上个月在其虚拟GDC演示文稿中,英特尔宣布令人兴奋的工具,它希望削减毒性游戏玩家必须在语音聊天中经历。根据英特尔,该应用程序“使用AI根据用户偏好来检测和缩短音频。”过滤器适用于传入的音频,作为额外的用户控制层次,在其上已经提供的平台或服务之上。

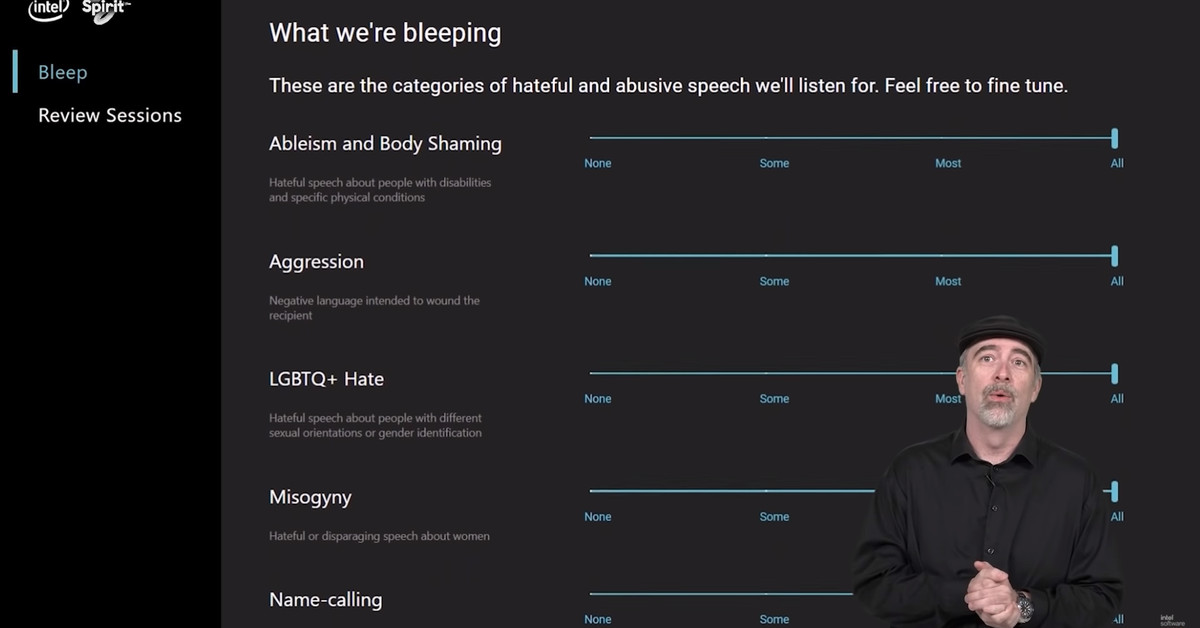

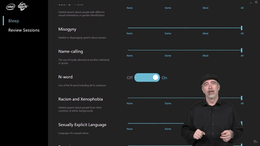

这是一个崇高的努力,但是有些有趣的博格尔界面有趣,其中列出了人们可能在线遇到的所有不同类别的滥用行为,配对滑块来控制虐待用户想要听到的数量。类别范围从“攻击”到“LGBTQ +仇恨”的任何地方,“厌恶,”“种族主义和仇外心理”和“白民族主义”。甚至没有用于n-word的切换。 Bleep的页面指出,它还未进入公共测试版,所以所有这些都可能有所变化。

随着这些类别的大多数类别,哔哔声似乎为用户提供了一种选择:你想要没有,有些,或所有这些攻击性语言都会被筛选出来吗?喜欢从有毒的互联网浆料自助餐时,英特尔的界面使玩家可以选择在攻击或姓名呼叫在线游戏的灯光下洒键。

现在已经在工程中遭到了几年的作品 - PCMAG指出,英特尔在2019年的GDC讨论了这一主动的方式 - 它正在与软件上的AI审核专家精神AI合作。但是使用人工智能抚养在线空间并没有简单的壮举,因为像Facebook和YouTube这样的平台已经显示出来。虽然自动化系统可以识别简单的令人反感的词语,但他们经常无法考虑某些侮辱和威胁的背景和细微差别。在线毒性有很多,不断不断发展的形式,即使是最先进的AI适度系统也是困难的。

“虽然我们认识到像滚动这样的解决方案,但我们认为这是一个朝着正确方向的一步,给游戏玩家一个控制他们的经验的工具,”英特尔的罗杰钱德勒在其GDC演示期间表示。英特尔表示希望在今年晚些时候发布滚动,并补充说,该技术依赖于其硬件加速的AI语音检测,这表明该软件可能依赖于英特尔硬件来运行。