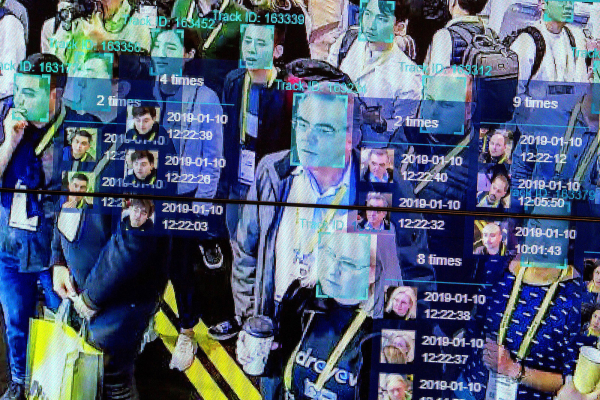

MEPS要求欧洲AI规则在公共场合禁止生物识别监测

他们还敦促欧盟立法者对人民敏感特征的自动承认(如性别,性,种族/种族,健康状况和残疾) - 警告这种促进的措施造成了太大的权利风险并燃料歧视。

预计委员会将向下周提供框架的框架提出框架,而是本周泄露的草案副本(通过政策)。并且,正如我们之前报道的那样,这种泄露的草案不包括在公共场所使用面部识别或类似的生物识别远程识别技术,尽管承认公众对该问题的强度有关。

“公开可访问空间的生物识别大规模监控技术广泛受到错误地报告大量无辜公民,系统地歧视非代表性的群体,并对自由和多样化的社会产生寒冷的影响。这就是为什么需要禁令的原因,“MEPS现在写在委员会的一封信中,他们也公开了。

他们继续通过人们敏感特征的自动推断来警告歧视的风险 - 例如通过其生物特征的预测性警务或不分青红皂白的监测和跟踪群体的应用。

“这可能导致危害包括违反隐私和数据保护的权利;抑制自由言论;让它更难暴露腐败;对每个人的自主权,尊严和自我表达有一个寒冷的影响 - 特别可能会严重伤害LGBTQI +社区,颜色的人民和其他歧视的对阵群体,“MEPS写信,呼吁委员会修改AI提案为了保护欧盟公民权利和面临歧视风险的社区的权利,禁止做法,并因此从歧视性工具提升到AI的歧视性工具的风险增加)。

“AI提案为禁止自动承认性别,性行为,种族/种族,残疾和任何其他敏感和保护特征的自动承认,提供了一个受欢迎的机会。

委员会提案的泄露草案确实解决了不分青红皂白地监测 - 提议禁止这种做法,以及禁止通用社会信用评分系统。

然而,MEP希望立法者进一步 - 警告泄露草案措辞中的弱点,并建议改变,以确保拟议的禁令涵盖所有未明确的和不分青红皂白的大规模监督,无论有多少人都接触到系统。

他们还表达了豁免禁止禁止对公共当局(或为其工作的商业实体)进行大规模监督的提案的警报 - 警告这一风险偏离现有欧盟立法以及集团在该地区的大众法院的解释。

“我们强烈抗议本第4条的拟议第二段,该第4条将豁免公共当局甚至代表他们的私人行为者,以便维护公安”,“他们写。 “公安正是大众监督是有合理的,它实际上是相关的,并且法院在法院始终如一地赎回了对个人数据的不分青红皂白处理的立法(例如,数据保留指令)。需要删除这种雕刻。“

“这段第二段甚至可以被解释为偏离其他副立法,即司法法院到目前为止解释为禁止大规模监督,”他们继续。 “拟议的AI规则需要使其要求尽可能清楚,除了数据保护获取而导致的那些,它还适用于此,并没有取代它。泄露的草案中没有这种清晰度。“

已联系委员会对MEPS的呼吁进行了意见,但在AI条例草案的官方透露之前,不可能这样做 - 预计下周中期。

无论AI提案是否会在现在那之间发生任何重大修正案,仍有待观察。但MEPS已经解雇了SWIFT警告镜头,即基本权利必须是共同立法辩论的关键特征 - 并将立法者提出了一个框架,以确保“值得信赖”AI不会看出,如果规则没有解决不道德的技术。