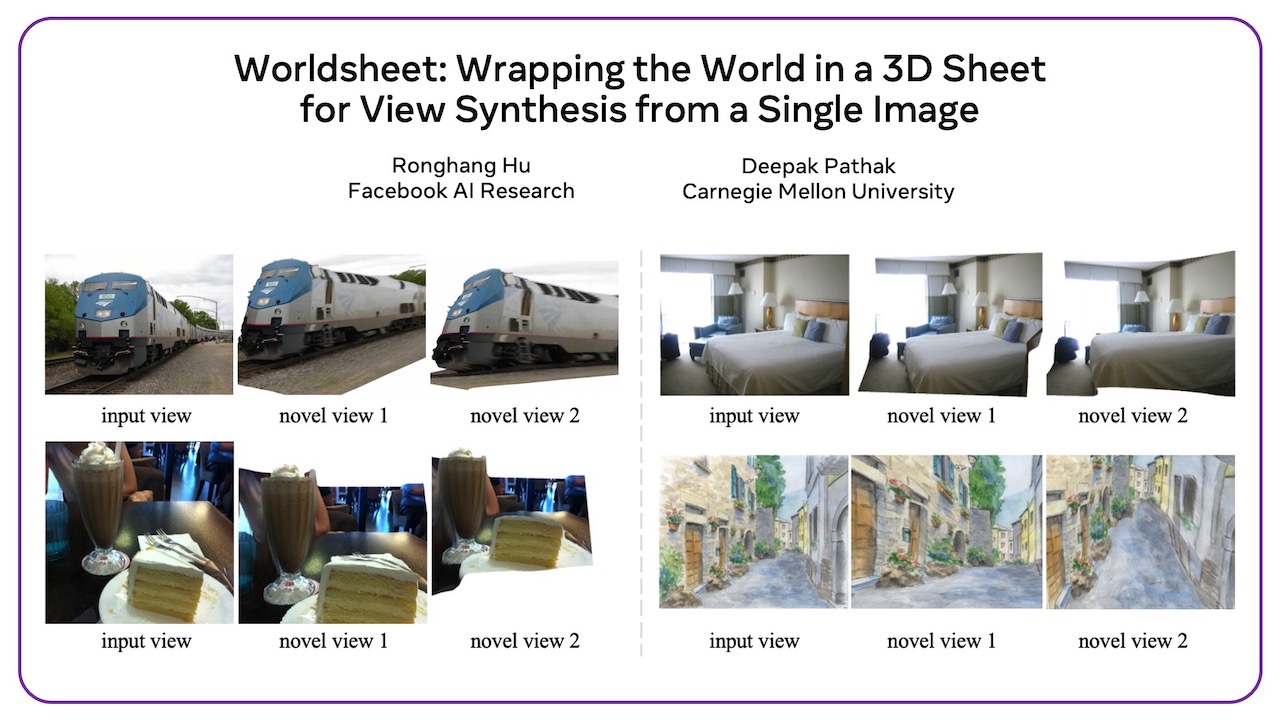

Worldsheet:将世界包裹在3D图纸中,从单个图像查看合成

我们介绍了Worldsheet,一种仅使用单个RGB图像作为输入的新颖视图合成方法。这是一个具有挑战性的问题,因为它需要了解场景的3D几何形状以及纹理映射以从新的视点生成可见区域和遮挡区域。我们的主要见解是,只需将平面网格薄板收缩包装到输入图像上即可,与学习到的中间深度相一致,可以捕获足以生成具有真实大的视点变化的照片级看不见视图的基本几何形状。为了实现这一点,我们提出了一种新颖的可微分纹理采样器,该采样器可以使包裹的网状薄板纹理化。然后通过可区分的渲染将其转换为目标图像。我们的方法是与类别无关的,无需任何3D监督即可进行端到端培训,并且在测试时仅需要一张图像。在多个数据集上,Worldsheet在单图像视图合成方面始终优于现有的最新技术。此外,这个简单的想法在将各种高分辨率的野生图像转换成可导航的3D弹出窗口时,可以很好地捕获新颖的视图。

给定一个输入视图,我们通过网格偏移和深度将网格表扭曲到场景几何上来构建场景网格。然后,我们对场景网格的UV纹理贴图进行差异采样,并从目标相机的姿势进行渲染以输出新颖的视图。在新颖的视图上使用2D渲染损失来端到端学习我们的网格变形。

我们在三个基准数据集上评估并与以前的方法进行了比较:Matterport,副本和RealEstate10K。在PSNR和其他指标下,我们的模型大大优于以前的工作(有关详细信息,请参见论文)。

与先有技术基于点云的SynSin(Wiles等人2020)相比,我们的Worldsheet可以更好地概括较大的视点变化,并且文物更少。

有时,当深度在对象边界附近不连续时,会出现伪影。例如,花或树的边界是模糊的。我们希望在以后的工作中通过围绕深度边界对Worldsheet进行细分来解决这些问题。

@article {hu2020worldsheet,作者= {Hu,Ronghang和Pathak,Deepak},标题= {Worldsheet:将世界包裹在3D图纸中以从单个图像合成视图合成},期刊= {arXiv预印本arXiv:2012.09854},年份= {2020},}