神经网络

2022-2-21 6:24

简要介绍一下上下文:上周在人工智能中包括了一份每周人工智能新闻摘要的时事通讯、一个报道赛义德新闻的播客,以及评论这条新闻的社论。如果你订阅,我们会很高兴的!

TLDR:在OpenAI Cheif科学家Ilya Sutskever在推特上表示大型神经网络可能“稍微有意识”之后,AI推特和其他地方引发了一场激烈的辩论。虽......

2022-2-17 17:52

这个过程是自动的。您的浏览器将很快重定向到您请求的内容。

2022-2-17 2:50

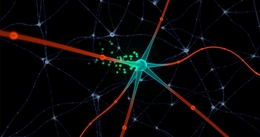

两个尖峰神经元中基于事件的反向传播和一个依赖于尖峰时间的损失函数\(\mathcal{L}\)。最后的累积值是\(\frac{\mathrm{d}\mathcal{L}}{\mathrm{d}w}\)。这是模拟数据的可视化。尖峰神经元使用离散的尖峰事件进行通信,这会导致神经元模型的动力学不连续。基于梯度的优化意味着什......

2022-2-15 10:11

在OpenAI首席科学家厚颜无耻地宣称一些神经网络可能已经开始获得意识后,该领域的其他人正在回击。

在我们昨天指出OpenAI联合创始人伊利亚·萨茨基弗(Ilya Sutskever)曾隐晦地宣称“今天的大型神经网络可能有点意识”之后,就出现了这种反弹

发表后,人们纷纷回应,其中一些人代表了有知觉的人工智能,但许多人......

2022-2-12 23:35

我们的物种在很大程度上要归功于相对的拇指。但如果进化给了我们额外的拇指,情况可能不会有多大改善。每只手一个拇指就够了。

神经网络则不然,它是执行类似人类任务的领先人工智能系统。随着他们变得越来越大,他们开始掌握更多。这让旁观者大吃一惊。基本的数学结果表明,网络应该只需要这么大,但现代神经网络的规模通常远远超出了预期的......

2021-8-5 21:4

卷积神经网络在机器学习中非常重要。如果你想做计算机视觉或图像识别任务,你就离不开它们。但是很难理解它们是如何工作的。在这篇文章中,我们将讨论卷积神经网络背后的机制、它们的好处和业务用例。首先,让我们复习一下神经网络一般如何工作的知识。任何神经网络,从简单的感知器到庞大的企业 AI 系统,都由模仿人脑神经元的节点组成。......

2021-8-3 2:58

在我们的每个大脑中,有 860 亿个神经元并行工作,处理来自感官和记忆的输入,以产生人类认知的许多壮举。其他生物的大脑没有那么广泛的能力,但这些动物通常表现出对特定任务的先天能力,这些能力是经过数百万年的进化磨练出来的。我们大多数人都见过动物做聪明的事情。也许您的家养宠物是逃生艺术家。也许您住在鸟类或蝴蝶的迁徙路线附......

2021-7-29 22:15

据人工智能研究公司 OpenAI 称,Nvidia 的图形处理单元太难编程,包括使用 Nvidia 自己的编程工具 CUDA。这家总部位于旧金山的人工智能初创公司在微软和风险投资公司 Khosla Ventures 的支持下,于周三推出了 1.0 版本,这是一种专门为减轻这一负担而设计的新编程语言 Triton,在一......

2021-7-29 22:0

我们正在发布 Triton 1.0,这是一种类似于 Python 的开源编程语言,它使没有 CUDA 经验的研究人员能够编写高效的 GPU 代码——大部分时间与专家能够编写的代码相当。 Triton 使得以相对较少的努力达到峰值硬件性能成为可能;例如,它可以用不到 25 行代码编写与 cuBLAS 性能相匹配的 FP......

2021-6-23 2:47

下载PDF摘要:表格数据集是最后一个" uncthed castle"对于深度学习,具有梯度提升决策树等甚至仍然针对最近的专业神经架构的梯度提升决策树的方法。在本文中,我们假设提高神经网络性能的关键延续了一大集现代化技术的关节和同时应用。因此,我们通过在使用Ajoint Optimization上搜索......

2021-6-10 19:54

下载PDF摘要:三个因素驱动AI的进展:算法创新,数据和培训的计算。算法的进度比计算和数据量更难以量化。在这方面,我们认为算法进步有一个方面是既既衡量和有趣的方面,可以减少计算,以达到过去的能力。我们表明,培训分类器所需的浮点数为亚历克莱级性能OnimAgeNet的数量在2012年和2019年之间的44倍下降了44倍......

2021-6-4 5:44

下载PDF摘要:与神经科学和深度学习相交,为两个领域带来了福利和发展,几十年来,这有助于了解大脑中的学习作品,并在不同的AI基准中实现最先进的艺术形象。 Backpropagation(BP)是人工神经网络训练的最完整采用的方法,但是,由于其生物言言,通常批评(例如,缺乏参数的缺乏局部更新规则)。因此,依赖于预测编码......

2021-6-3 23:14

下载PDF摘要:尖峰神经网络将模拟计算与基于事件的基于Comcomication使用离散尖峰相结合。虽然通过使用Backpradogation算法训练非尖峰人工神经网络的令人印象深刻的防范的进步,但将该算法应用于尖峰网络,因此是通过离散的尖峰事件和分解的不存在性的存在。首次,这项工作通过将伴随方法与适当的部分移动性跳......

2021-5-8 23:13

宇宙在数十亿年内发展了数十亿,但研究人员已经开发了一种在不到一天内创建复杂的模拟宇宙的方法。本周发表的技术与国家科学院讨论,汇集了机器学习,高性能计算和天体物理学,并有助于迎来新的高分辨率宇宙学模拟时代。

宇宙模拟是挑选宇宙的许多奥秘的重要组成部分,包括暗物质和黑暗能量。但到目前为止,研究人员面临着无法实现的常见难......

2021-5-7 7:9

新闻:一种新型的攻击可以提高AI系统的能量消耗。以同样的方式对互联网的拒绝服务攻击寻求堵塞网络并使它无法使用,新攻击强制了深度神经网络,以符合必要的计算资源,并减慢其“思维”过程。

目标:近年来,对大型AI型号的昂贵能源消耗的越来越关注导致研究人员设计更高效的神经网络。一个类别,称为自适应多退出架构,通过根据它们......

2021-4-9 9:1

赖斯大学计算机科学家展示了在商品处理器上运行的人工智能(AI)软件,并在基于图形处理器的平台上速度快15次培训深度的神经网络。 "培训成本是AI,&#34的实际瓶颈; Anshumali Shrivastava是米饭'布朗工程学院的计算机科学助理教授。 "公司每周花费数百万美元才能训练和微调他......

2021-4-9 0:7

功能API - 所有其他API构建的数字定义的低级API(DEFN)。

模型创建API - 管理模型初始化和应用程序的高级模型创建API。

Axon提供抽象,可轻松集成,同时保持每个组件之间的分离级别。您应该能够在没有依赖性的情况下使用任何API。通过解耦API,Axon可以完全控制创建和培训神经网络的每个方......

2021-4-6 12:34

使用3D打印机,UCLA Samueli工程学院的一支研究团队创造了一个人工神经网络,可以分析大量数据并以光速识别对象。该技术使用来自物体的光散射来识别它来识别衍射深度神经网络(D2NN)。该技术基于基于深度学习的被动衍射层的设计,其共同工作。该团队创建了一种计算机模拟的设计,然后使用3D打印机创建薄,8厘米-SQ聚......

2021-4-5 15:31

如果您就像我一样,困惑的是为什么深神经网络可以概括到样本数据点而无剧烈过度装备,请继续阅读。

如果你就像我一样,在传统机器学习的经验中进入深度学习的领域,你可能经常在这个问题上思考:由于典型的深神经网络有这么多参数和训练错误,可以很容易地完美,它肯定会受到影响从实质上的过度装备。如何概括为样本数据点?

理解为什......

2021-3-20 9:19

Freewire是一种类似KERAS的API,用于创建优化的可自由有线的神经网络,到史隆CUDA。自由有线的神经网络在各个节点(或神经元)的水平上定义,而不是在均匀层的水平。Freewire的目标是使其成为人工神经元的任何任意DAG定义为首先定义可以在CUDA上运行RunTimeand编译优化的操作集。

该存储库是......

2021-3-14 18:37

下载PDF摘要:在过去几年中,神经网络已经对抗震诠释的兴趣激增。基于网络的学习方法难以快速准确的自动解释,提供了许多训练标签。我们在熟悉前向模型和反转框架的地球物理学家介绍了Fieldaimed。我们解释了深度网络与其他地球物理逆问题之间的相似性和差异,并展示了他们的井层,地震图像之间岩性插值等岩性插值。我们的方法对......

2021-2-26 17:6

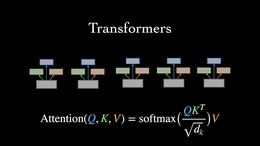

下载PDF摘要:本文未描述工作系统。取而代之的是,它提出了一个关于表示的想法,该想法使几个不同的群体所取得的进步可以组合成一个称为GLOM的假想系统。这些进步包括变压器,神经场,对比表示学习,蒸馏和胶囊。 GLOM回答了这个问题:具有固定体系结构的神经网络如何将图像解析为部分整体的层次结构,而每个部分的结构都具有不同......

2021-2-21 7:51

在2007年,深层神经网络背后的一些主要思想家在著名的人工智能年度会议的间隙组织了一次非正式的“卫星”会议。会议拒绝了他们举行正式讲习班的要求;深度神经网络距离接管人工智能还需要几年的时间。盗版会议的最终发言人是多伦多大学的杰弗里·欣顿(Geoffrey Hinton),他是认知心理学家和计算机科学家,负责深网领域的......

2021-1-28 23:46

通常,在训练阶段之后,在此阶段中,向神经网络算法提供了大量相关的目标数据以磨练其推理能力,并奖励正确的响应以优化性能,因此它们基本上是固定的。但是,哈萨尼(Hasani)的团队开发了一种方法,通过这种方法,他的“液体”神经网络可以随着时间的流逝而适应新信息,以适应“成功”的参数,这意味着,如果要在自动驾驶汽车上感知的......

2021-1-24 4:18

三分之二等于六,或者至少是我天真的期望。

众所周知,浮点矩阵乘法可能会导致各种意外情况,但您是否知道量化神经网络也不是确定性的?量化神经网络使用整数将神经网络中的权重和激活值相乘。幼稚的逻辑说,两个和三个表示并乘以整数的乘积始终应得出完全相同的结果,即六个。

但是,根据Android NNAPI驱动程序验证文档,......